오늘은 머신러닝 분야에서 정말 멋진 기술 중 하나인 **부스팅(Boosting)**에 대해 이야기해 볼 거예요. 이름부터 뭔가 힘이 느껴지지 않나요? 부스팅은 말 그대로 "들어 올리다", "향상시키다"라는 뜻처럼, 약한 예측 모델들을 모아 훨씬 강력한 모델을 만드는 마법 같은 기술이랍니다! ✨

앙상블 학습의 똑똑한 친구, 부스팅 🤝

앙상블 학습이라는 말을 들어본 적이 있나요? 여러 전문가의 의견을 모아서 더 정확한 결론을 내는 것처럼, 앙상블 학습은 여러 개의 작은 **머신러닝 모델(약한 학습기)**들을 합쳐서 하나의 크고 강력한 모델을 만드는 방법이에요. 부스팅은 바로 이 앙상블 학습의 한 종류랍니다. 여러 모델이 각자의 부족한 점을 보완하며 성장하는 과정이 마치 친구들이 서로 도와가며 문제를 해결하는 모습과 비슷해요.

부스팅은 어떻게 똑똑해질까요? 🧐

부스팅은 일반적인 앙상블 학습과는 조금 다른 특별한 방식으로 똑똑해져요. 마치 운동 코치가 선수의 약점을 정확히 파악해서 집중 훈련을 시키는 것과 비슷하답니다!

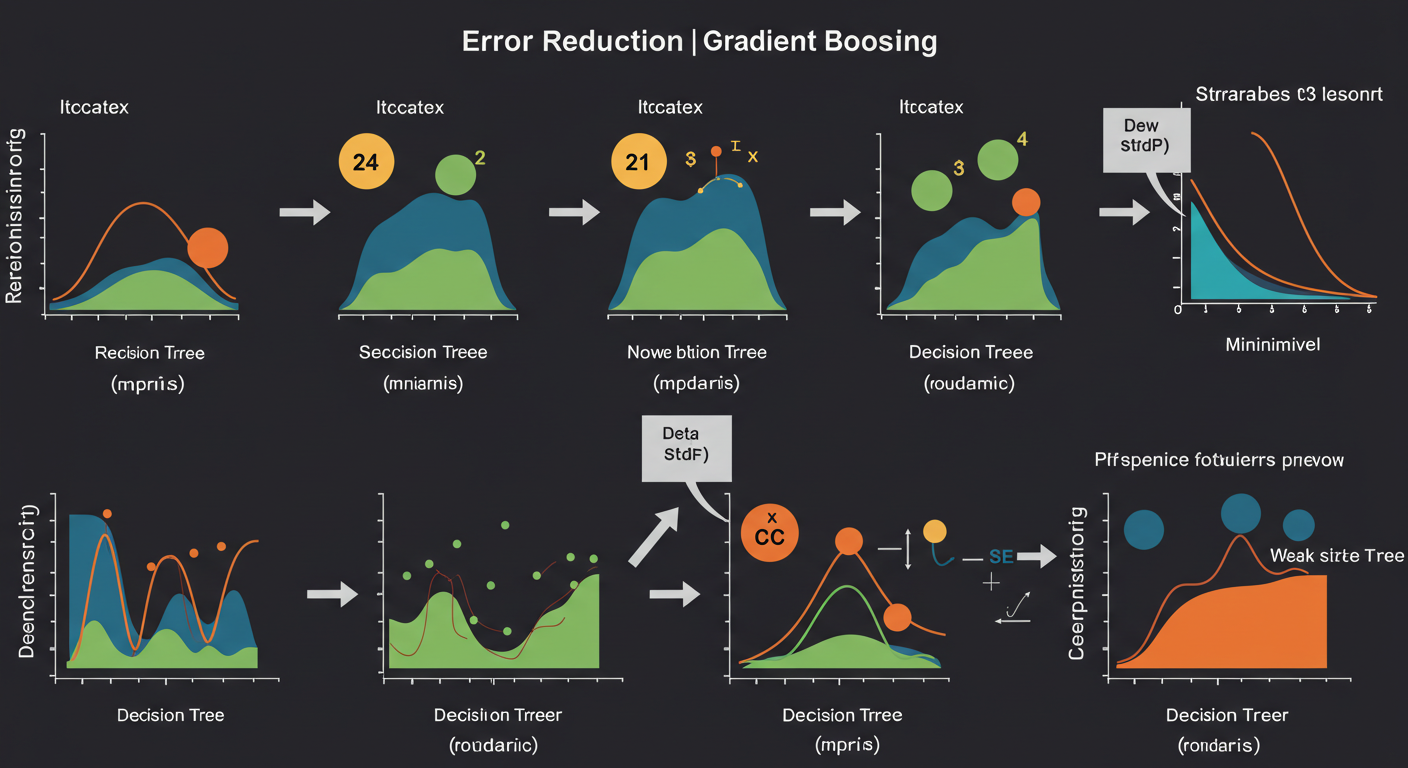

- 첫 번째 모델의 등장!: 먼저, 첫 번째 모델이 데이터를 보고 예측을 시작해요. 이 모델은 아직 완벽하지 않아서 틀리는 부분이 있을 거예요.

- 오답 노트 작성: 부스팅은 첫 번째 모델이 틀린 부분, 즉 오류에 집중해요. 마치 우리가 시험 보고 틀린 문제를 오답 노트에 정리하는 것처럼요.

- 다음 모델에게 집중 과외: 이제 다음 모델이 등장하는데, 이 모델은 첫 번째 모델이 틀렸던 부분들을 더 잘 맞추도록 가중치를 높여서 집중적으로 학습해요. "얘들아, 이 부분은 지난번에 틀렸으니 더 신경 써서 봐!" 하고 알려주는 거죠.

- 계속해서 반복: 이 과정을 계속해서 반복해요. 새로운 모델이 추가될 때마다 이전 모델이 어려워했던 부분들을 더 잘 맞추도록 훈련시키고, 결국 모든 약점을 보완해서 아주 강력한 최종 모델을 만들어낸답니다.

이렇게 부스팅은 이전에 예측을 잘 못했던 데이터에 더 많은 가중치를 부여하고, 새로운 약한 학습기가 그 데이터를 집중적으로 학습하면서 점차 모델의 성능을 향상시키는 방식이에요. 마치 퍼즐 조각을 하나씩 맞춰나가면서 전체 그림을 완성하는 과정과 같죠.

부스팅의 주요 알고리즘들: 각자의 매력 💖

부스팅에는 여러 가지 알고리즘이 있지만, 그중에서도 가장 유명하고 많이 사용되는 몇 가지를 소개해 드릴게요. 이 친구들은 각각 다른 매력을 가지고 있답니다.

- AdaBoost (Adaptive Boosting): 부스팅의 원조 격인 알고리즘이에요. 틀린 데이터에 가중치를 주는 방식을 처음으로 제시했어요.

- Gradient Boosting: AdaBoost에서 한 단계 더 발전한 알고리즘이에요. 예측 오차(잔차)를 줄이는 방향으로 모델을 계속 업데이트한답니다. 미분 개념을 활용해서 오차를 '경사'를 따라 내려가는 것처럼 줄여나가요.

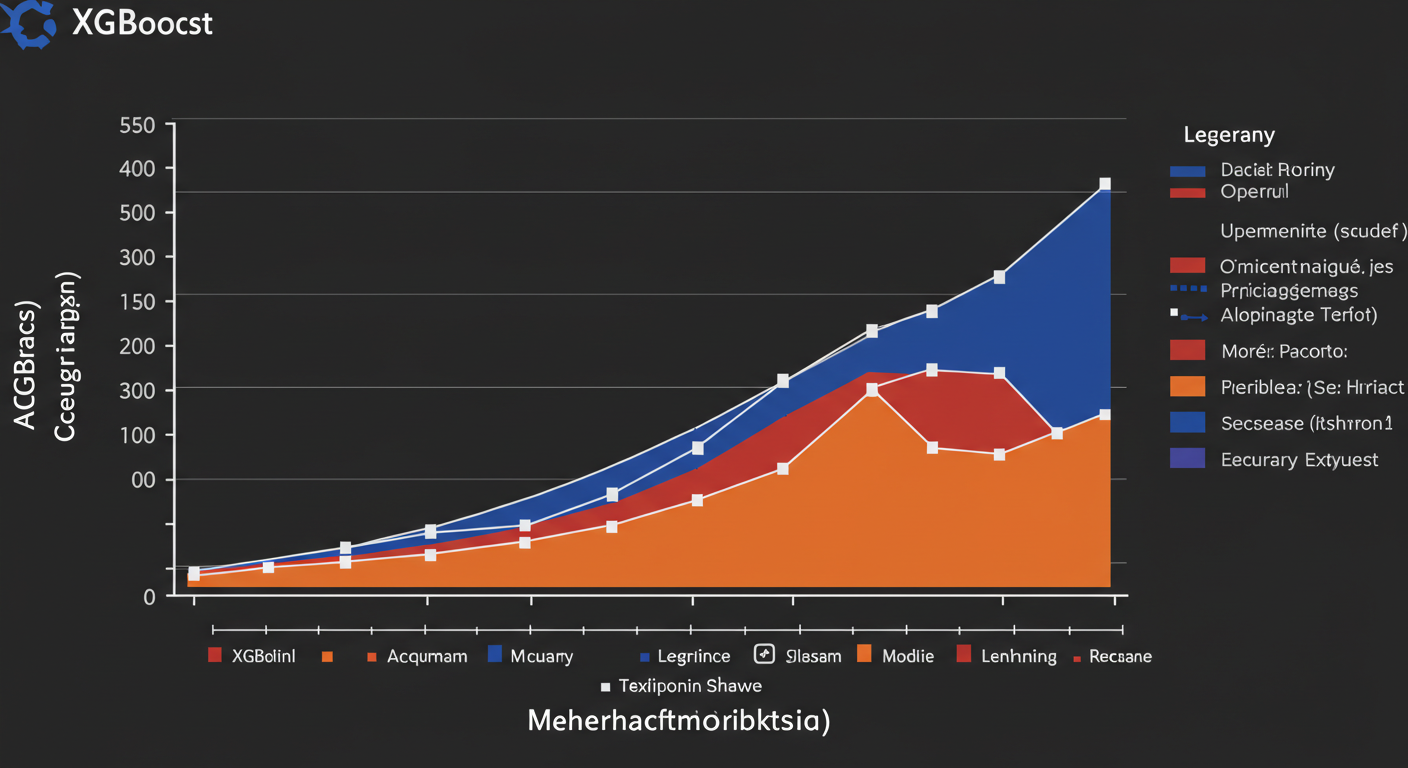

- XGBoost (eXtreme Gradient Boosting): Gradient Boosting의 성능을 극한으로 끌어올린 알고리즘이에요! 속도도 빠르고, 정확도도 높아서 캐글(Kaggle) 같은 머신러닝 경진대회에서 정말 많이 사용된답니다. 😊 엑스지부스트는 병렬 처리, 결측치 처리 등 다양한 기능으로 더욱 강력해졌어요.

- LightGBM (Light Gradient Boosting Machine): 이름처럼 '가벼운' 부스팅 알고리즘이에요. XGBoost만큼 강력하면서도 훨씬 빠르고 효율적으로 작동해요. 대용량 데이터에서도 뛰어난 성능을 보여준답니다.

- CatBoost (Categorical Boosting): 범주형 데이터를 처리하는 데 특화된 부스팅 알고리즘이에요. 데이터에 숫자뿐만 아니라 '성별', '도시 이름' 같은 글자 데이터가 많을 때 특히 유용하죠.

부스팅 알고리즘 비교 (주요 특징) 📊

| 특징 | AdaBoost | Gradient Boosting | XGBoost | LightGBM | CatBoost |

| 주요 아이디어 | 잘못 예측된 데이터에 가중치 부여 | 잔차(오차)를 예측하여 모델 개선 | Gradient Boosting의 성능 및 속도 개선 | 더 빠르고 효율적인 Gradient Boosting | 범주형 데이터 처리 특화 |

| 장점 | 간단하고 강력함 | 예측력이 우수함 | 높은 정확도, 빠른 속도, 다양한 기능 지원 | 매우 빠른 학습 속도, 적은 메모리 사용, 대용량 데이터 처리 우수 | 범주형 데이터 전처리 자동화, 높은 정확도 |

| 단점 | 이상치에 민감, 과적합 위험 | 속도가 느릴 수 있음, 매개변수 튜닝 필요 | 매개변수 튜닝 복잡, 메모리 사용 많을 수 있음 | 작은 데이터셋에서는 과적합 위험, 민감한 매개변수 튜닝 필요 | 학습 속도가 느릴 수 있음 (초기), GPU 사용 시 성능 향상 |

부스팅은 어디에 활용될까요? 💡

부스팅은 그 강력함 덕분에 다양한 분야에서 활용되고 있어요. 마치 만능 재주꾼 같아요!

- 광고 추천 시스템: 여러분이 좋아할 만한 상품이나 광고를 정확히 추천해 줄 때 부스팅이 사용될 수 있어요. 🛍️

- 금융 사기 탐지: 누가 돈을 속여서 빼가는지 미리 알아내서 사기를 막는 데 도움을 줘요. 💰

- 의료 진단: 환자의 데이터를 분석해서 질병을 예측하고 진단하는 데 활용되기도 한답니다. 🏥

- 이미지 및 음성 인식: 사진 속의 물체가 무엇인지, 사람이 말하는 내용을 이해하는 데도 기여해요. 🖼️🗣️

- 날씨 예측: 복잡한 기상 데이터를 분석해서 더 정확한 날씨를 예측하는 데도 사용될 수 있어요. ☀️☔

이처럼 부스팅은 우리 생활과 밀접한 다양한 분야에서 데이터 분석과 예측을 통해 더 나은 결정을 돕는 데 큰 역할을 하고 있답니다.

마무리하며: 부스팅, 미래를 만드는 힘! 🌟

부스팅은 여러 약한 학습기들이 힘을 합쳐 하나의 강력한 모델을 만드는 과정이 마치 서로 돕고 성장하는 우리들의 모습과 닮았다는 생각이 들어요. 복잡한 데이터를 이해하고 미래를 예측하는 데 꼭 필요한 기술이죠. 머신러닝 알고리즘 중에서 특히 뛰어난 성능을 자랑하며, 지금도 많은 사람들이 부스팅을 활용해서 새로운 기술을 개발하고 문제를 해결하고 있답니다. 💖

요약 정리 📝

- **부스팅(Boosting)**은 여러 약한 예측 모델(약한 학습기)들을 순차적으로 학습시켜 더 강력한 하나의 모델을 만드는 앙상블 학습 방법입니다.

- 이전 모델이 **틀린 부분(오류)**에 집중하여 다음 모델이 학습하도록 가중치를 부여하며 성능을 향상시킵니다.

- 주요 알고리즘으로는 AdaBoost, Gradient Boosting, XGBoost, LightGBM, CatBoost 등이 있습니다.

- 높은 정확도와 빠른 속도 덕분에 광고 추천, 금융 사기 탐지, 의료 진단 등 다양한 분야에서 활용됩니다.

'AI 및 관련 기술 확산(1960년대~1990년대)' 카테고리의 다른 글

| 똑똑한 인공지능 비서, 전문가 시스템 완벽 해부! (4) | 2025.07.05 |

|---|---|

| 빅데이터 시대의 핵심, 데이터 마이닝으로 숨은 보물을 찾아보자! 💎 (7) | 2025.07.04 |

| 빅데이터, 언제 어디서 나타났을까? 쉽고 재미있는 빅데이터 이야기 (4) | 2025.07.01 |

| A/B 테스트: 초등학생도 이해하는 쉬운 개념 설명! (4) | 2025.06.30 |

| CNN이란? 이미지 인공지능의 핵심 원리 파헤치기! (4) | 2025.06.29 |